今日,一年一度的CVPR在美国拉斯维加斯召开。据悉,这场被认为是“计算机视觉和模式识别领域顶级学术会议”的大会将于美国西部时间6月26日至7月1日召开。

CVPR,是IEEE Conference on Computer Vision and Pattern Recognition的缩写,即IEEE国际计算机视觉与模式识别会议。CVPR作为世界顶级的计算机视觉会议(三大顶会之一,另外两个是ICCV和ECCV),每年都吸引千余名来访者参与会议,收录的论文数量一般在300篇左右。

CVPR会议上,众多高新企业悉数亮相,其中包括微软、Uber、亚马逊、HERE地图等,值得一提的是,此次参会的中国企业又创一新高,如百度、大疆、专注人脸识别的Face++、商汤科技、美图影像实验室,AR企业亮风台以及腾讯等等。

会议上都能看到啥?

给机器“看电视剧”预测人类行为

CVPR2016上,麻省理工学院计算机科学和人工智能实验室(CSAIL)将发布一份关于可预测人类行为的算法的研究报告。通过给此算法导入近600小时的电视秀(其中包括《生活大爆炸》《绝望主妇》《办公室》等剧集),来测试机器是否能准确预测人类在各场景互动中的行为。此次实验数据是人工智能“预测想象力”技术的显著进步。

基于深度学习的手势识别:能够用于VR交互

来自于美国普渡大学C Design 实验室的研究成果——DeepHand(深度手势识别),基于“深度学习”解析人手塑造的角度和扭曲等动作,这是一个新的突破,可以在未来加强VR设备的交互上有广泛应用前景。

微软全息传动技术:HoloPortation

HoloPortation将人物全息图像投射到另一个房间,使该房间内的人可以和全息影像实时互动,系统通过追踪人物身体的高质量细节,重建每一个特征。

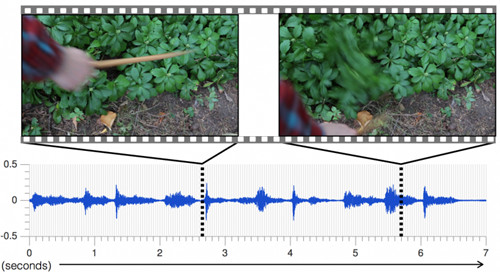

人工智能为视频配音:机器人感知世界又进一步

对于机器人而言,它们需要对周遭的一系列事件进行一种感知和预判。人类惯于使用声音作为感知世界的一个手段,机器人也能够一样吗?来自麻省理工大学实验室的团队(CSAIL)研发了一种算法,能够通过识别视频中的场景和动作为视频配音,效果几乎以假乱真。这似乎证明机器人对真实世界的认知又上升了一个台阶。

{{item.content}}